- Entropie (od Dr. Řecku. Ἐντροπία "otočit", "transformace") - termín široce používaný v přírodních a přesných vědách. To bylo nejprve zavedeno v rámci termodynamiky jako funkce stavu termodynamického systému, který určuje měřítko nevratné disperze energie. Ve statistické fyzice, entropie charakterizuje pravděpodobnost jakéhokoliv makroskopického stavu. Kromě fyziky je termín široce používán v matematice: Informační teorie a matematické statistiky.

Entropie lze interpretovat jako míra nejistoty (poruchy) nějakého systému, například jakákoli zkušenost (test), což může mít různé výsledky, což znamená, že výše informací. A další interpretace entropie je tedy informační kontejnerový systém. S tímto interpretací, skutečnost, že tvůrce konceptu entropie v teorii informací (Claude Shannon) byl poprvé chtěl pojmenovat tuto částku informací.

Koncept informační entropie se používá jak v teorii informačních a matematických statistik, tak ve statistické fyzice (entropie Gibbs a jeho zjednodušená verze - Boltzmann entropie). Matematický význam informační entropie je logaritmus dostupných stavů systému (základem logaritmu může být odlišná, určuje jednotku měření entropie). Tato funkce na počtu států poskytuje majetek entropy aditivity pro nezávislé systémy. Navíc, pokud se státy liší podle stupně dostupnosti (tj. To není rovno), v rámci počtu státních států, je nutné pochopit jejich účinnou částku, která je definována následovně. Nechte stav systému stejně a mají pravděpodobnost

(DisplayStyle p)

Pak počet států

(DisplayStyle n \u003d 1 / p)

(DisplayStyle Log n \u003d log (1 / p))

V případě různých pravděpodobností států

(DisplayStyle p_ (i))

Zvažte váženou průměrnou hodnotu

(DisplayStyle Log (Overline (n)) \u003d sum _ (i \u003d 1) ^ (n) p_ (i) log (1 / p_ (i)))

(DisplayStyle (Overline (n)))

Efektivní počet států. Z této interpretace přímo předpokládá výraz pro informační entropii Shannon

(DisplayStyle H \u003d log (přeloženo (n)) \u003d - sum _ (i \u003d 1) ^ (n) p_ (i) log p_ (i))

Takový výklad je také platný pro entropii RENI, což je jedním z zobecnění konceptu informační entropie, ale v tomto případě je určen efektivní počet systémových stavů (lze ukázat, že entropie RENI odpovídá k účinnému počtu států stanovených jako průměrný výkon vážený s parametrem

(DisplayStyle Q Leq 1)

Entropie (od Dr. Řecku. Ἐντροπία "otočit", "transformace") - termín široce používaný v přírodních a přesných vědách. To bylo nejprve zavedeno v rámci termodynamiky jako funkce stavu termodynamického systému, který určuje měřítko nevratné disperze energie. Ve statistické fyzice, entropie charakterizuje pravděpodobnost jakéhokoliv makroskopického stavu. Kromě fyziky je termín široce používán v matematice: Informační teorie a matematické statistiky.

Ve vědě, tento koncept vstoupil v XIX století. Zpočátku byl aplikován na teorii tepelných strojů, ale docela rychle se objevil ve zbytku fyzikálních oblastí, zejména v teorii záření. Velmi brzy začala entropie používat v kosmologii, biologii, v teorii informací. Různé oblasti znalostí přidělují různé typy opatření chaosu:

- informace;

- termodynamický;

- rozdíl;

- kulturní a ostatní.

Například pro molekulární systémy existuje boltzmann entropie, která určuje měřítko jejich chaotie a homogenity. Bolzman se podařilo navázat vztah mezi opatřením chaosu a pravděpodobností státu. Pro termodynamiku je tento koncept považován za míru nevratné energetické rozptylu. To je funkce stavu termodynamického systému. V samostatném systému roste entropie na maximální hodnoty a nakonec se stávají rovnovážným stavem. Informace o entropii předpokládá určité míře nejistoty nebo nepředvídatelnosti.

Entropie lze interpretovat jako míra nejistoty (poruchy) nějakého systému, například jakákoli zkušenost (test), což může mít různé výsledky, což znamená, že výše informací. A další interpretace entropie je tedy informační kontejnerový systém. S tímto interpretací, skutečnost, že tvůrce konceptu entropie v teorii informací (Claude Shannon) byl poprvé chtěl pojmenovat tuto částku informací.

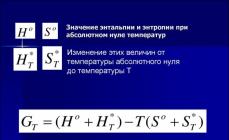

Pro reverzibilní (rovnovážné) procesy se provádí následující matematická rovnost (důsledek tzv. Klauzule), kde - dodávané teplo, teplota a stavy a entropie odpovídající těmto stavům (proces Zde se uvažuje o přechodu ze stavu do státu.

Pro nevratné procesy, nerovnost teče z takzvaného nerovnosti Clausia, kde - zavěšené teplo je teplota a stavy a entropie odpovídající těmto stavům.

Proto entropie adiabaticky izolované (bez dodávky nebo odstranění tepla) systému s nevratnými procesy se může zvýšit.

Použití konceptu entropie Clausius (1876) dal nejvážnější formulaci 2. začátku termodynamiky: S reálnými (nevratnými) adiabatickými procesy se entropie zvyšuje, dosahující maximální hodnoty v rovnovážném stavu (2. začátek termodynamiky není absolutní, Během kolísání je přerušeno).

Absolutní entropie (y) látka nebo proces - Jedná se o změnu dostupné energie během přenosu tepla při dané teplotě (BTU / R, J / K). Matematicky entropie se rovná přenosu tepla, rozdělené na absolutní teplotu, při které proces probíhá. V důsledku toho, přenosové procesy velkého množství tepla zvyšují entropii. Také změny entropie se zvýší při přenosu tepla při nízkých teplotách. Vzhledem k tomu, že absolutní entropie se týká vhodnosti celé energie vesmíru, teplota se obvykle měří v absolutních jednotkách (R, K).

Specifická entropie (Y) opatření vzhledem k hmotnosti hmotnosti látky. Teplotní jednotky, které se používají při výpočtu rozdílů entropie států, jsou často dány s teplotními jednotkami v Fahrenheit nebo Celsia stupňů. Vzhledem k tomu, že rozdíly ve stupních mezi Fahrenheita a Scales Renkin nebo Celsius a Celsius a Celvin jsou stejné, řešení v takových rovnicích bude správné bez ohledu na to, zda je entropie vyjádřena v absolutních nebo běžných jednotkách. Entropie má stejnou teplotu jako tato entalpie určité látky.

Shrneme se: entropie se zvyšuje, tedy jakýmkoliv jinými akty zvyšujeme chaos.

Jen o obtížném

Entropie - míra poruchy (a charakteristika stavu). Vizuálně, tím rovnoměrnější věci se nacházejí v určitém prostoru, čím více entropie. Pokud se cukr spočívá v šálku čaje ve formě kusu, entropie tohoto stavu je malá, pokud je rozpuštěna a distribuována po celém objemu - skvělé. Nepořádek může být měřen například tím, že zváží, kolik způsobů je možné rozložit objekty v daném prostoru (entropie pak úměrná logaritmu počtu rozvržení). Pokud jsou všechny ponožky složené extrémně kompaktní jeden zásobník na polici ve skříni, počet možností rozvržení je málo a je sníženo pouze na počet přeskupení ponožek v zásobníku. Pokud ponožky mohou být v libovolné lokalitě v místnosti, pak je zde nemyslitelný počet způsobů, jak je rozložit, a tyto rozložení se během našeho života neopakují, jako je tvar sněhových vloček. Entropie stavu "ponožek roztroušených" je obrovská.

Druhý zákon termodynamiky uvádí, že entropie se v uzavřeném systému nesnižuje (obvykle se zvyšuje). Pod jeho vlivem je kouř rozptýlen, cukr rozpouští, rozptýlené časem kamenů a ponožek. Tento trend je vysvětlen jednoduše: věci se pohybují (přesunuty u nás nebo silami přírody) je obvykle pod vlivem náhodných impulzů, které nemají žádný společný cíl. Pokud jsou impulsy náhodné, všechno se bude pohybovat od řádu k nepořádku, protože způsoby dosažení poruchy je vždy větší. Představte si šachovnice: Král se může dostat z úhlu třemi způsoby, všechny možné způsoby, které jsou pro to, jsou z úhlu, a vrátit se do úhlu od každé sousední buňky - pouze jedním způsobem, a tento kurz bude jen jeden 5 nebo od 8 možných pohybů. Pokud zbavíte jeho cíle a dovolit náhodně pohybovat se, že nakonec se stejnou pravděpodobností může být na libovolném místě šachovnice, entropie bude vyšší.

V plynu nebo kapalině hraje role takové neuspořádané moci tepelný pohyb, ve vašem pokoji - vaše zkrácené touhy tam jít, zde, hledat, pracovat atd. Co tyto touhy nezáleží, hlavní věc je, že nesouvisí s čištěním a nejsou navzájem spojeny. Chcete-li snížit entropii, musíte odhalit systém k vnějšímu vlivu a pracovat na něm. Například podle druhého zákona se entropie v místnosti neustále zvyšuje, dokud matka nejezne a neptá vás mírně, abyste získali. Je třeba provést práci také tím, že jakýkoli systém odolává snížení entropie a poradenství. Ve vesmíru, stejný příběh - entropie, který se začal zvyšovat s velkým výbuchem, takže bude růst, dokud přijde máma.

Mea chaos ve vesmíru

Pro vesmír nelze aplikovat klasické provedení entropie, protože je v něm aktivní, gravitační síly jsou aktivní a samotná látka nemůže tvořit uzavřený systém. Ve skutečnosti je pro vesmír měřítkem chaosu.

Hlavní a největší zdroj poruchy, který je pozorován na našem světě, jsou považovány za známé masivní vzdělání - černé díry, masivní a supermasivní.

Pokusy o přesně vypočítat hodnotu opatření chaosu nelze nazvat úspěšným, i když se vyskytují neustále. Všechny odhady entropie vesmíru však mají významnou změnu hodnot získaných - od jedné do tří objednávek. To je vysvětleno nejen nedostatkem znalostí. Neexistuje žádná nedostatečnost informací o účincích na výpočty nejen ze všech známých nebeských objektů, ale i temné energie. Studium jeho vlastností a vlastností je stále v následujícím a účinek může být rozhodující. Mera Chaos vesmír se mění po celou dobu. Vědci neustále provádějí určité studie, aby získali možnost stanovení společných vzorů. Pak bude možné provést zcela jisté předpovědi pro existenci různých vesmírných objektů.

Tepelná smrt vesmíru

Každý uzavřený termodynamický systém má konečný stav. Vesmír není také výjimkou. Když se směrová výměna všech typů energií zastaví, jsou zamítnuty do tepelné energie. Systém přepne do stavu tepelné smrti, pokud termodynamická entropie obdrží nejvyšší hodnotu. Závěr o takovém pozdním světě byl formulován R. Clausiusem v roce 1865. Jako základ vzal druhý zákon termodynamiky. Podle tohoto zákona bude systém, který není vyměněn s energiemi s jinými systémy, bude hledat rovnovážný stav. A může mít parametry charakteristické pro tepelnou smrtí vesmíru. Ale Clausius nebral v úvahu vliv gravitace. To znamená, že pro vesmír na rozdíl od systému dokonalého plynu, kde jsou částice rovnoměrně rozloženy v určitém objemu, homogenita částic nemůže odpovídat největší hodnotě entropie. Nicméně, to není jasné, entropie je přípustným měřítkem chaosu nebo smrti vesmíru?

Entropie v našich životech

V vrcholu druhého začátku termodynamiky, podle ustanovení, jejichž by se vše mělo vyvíjet od obtížných jednoduchých, vývoj Evoluce Země se pohybuje v opačném směru. Tato nesrovnalost je způsobena termodynamikou procesů, které jsou nevratné. Spotřeba živého organismu, pokud je to představit jako otevřený termodynamický systém, se vyskytuje v menších svazcích, spíše než vyřazen z něj.

Potraviny mají méně entropie než produkty vyrobené z nich. To znamená, že tělo je naživu, protože to může odhodit toto opatření chaosu, který je vyroben v něm v důsledku toku nevratných procesů. Například odpařením z těla je odvozeno asi 170 g vody, tj. Lidské tělo kompenzuje snížení entropie s některými chemickými a fyzikálními procesy.

Entropie je určitým měřítkem volného stavu systému. Je to nejpletnější než menší omezení Tento systém má, ale za předpokladu, že existuje mnoho stupňů svobody. Ukazuje se, že nulová hodnota opatření Chaosu je úplná informace a maximum je absolutní nevědomost.

Náš celý život je tuhý entropie, protože opatření chaos někdy překračuje měřítko zdravého rozumu. Možná nejde tak daleko, když přijdeme na druhý začátek termodynamiky, protože někdy se zdá, že vývoj některých lidí a celých států, již se zvrátil, to znamená od složitého k primitivu.

závěry

Entropie - označení funkce stavu fyzického systému, zvýšení, ve kterém se provádí v důsledku reverzibilního (reverzibilního) přívodu tepla do systému;

hodnota vnitřní energie, která nemůže být transformována na mechanickou práci;

přesná definice entropie je provedena pomocí matematických výpočtů, se kterým je pro každý systém instalován odpovídající stavový parametr (termodynamický majetek) související energie. Nejrychlejší entropie se projevuje v termodynamických procesech, kde procesy, reverzibilní a nevratné, a v prvním případě, zůstává entropie nezměněna, a ve druhé je neustále roste a tento nárůst se provádí snížením mechanické energie.

V důsledku toho, že vše, co mnoho nevratných procesů, které se vyskytují v přírodě, doprovází poklesem mechanické energie, která by měla v konečném důsledku vést k zastavení, "tepelné smrti". To se však nemůže stát, protože z hlediska kosmologie není možné dokončit empirickou znalost všech "integrity vesmíru", na jejichž základě by naše myšlenka na entropie mohla najít zvukové aplikace. Křesťanští teologové věří, že založené na entropii, může být uzavřena o končetině světa a využít ho k vyvolání "existence Boha". V kybernetice se slovo "entropie" používá v určitém smyslu, odlišný od jeho přímé hodnoty, které mohou formálně odvodit pouze z klasického pojetí; To znamená: střední plnost informací; Nákaz o hodnotě "očekávání" informací.

viz také "Fyzický portál" Entropie lze interpretovat jako míra nejistoty (poruchy) nějakého systému, například jakákoli zkušenost (test), což může mít různé výsledky, což znamená, že výše informací. A další interpretace entropie je tedy informační kontejnerový systém. S tímto výkladem, skutečnost, že tvůrce konceptu entropie v teorii informací (Claude Shannon) byl poprvé vyzván tuto hodnotu informace.

H \u003d log \u2061 n ¯ \u003d - σ i \u003d 1 n p i log \u2061 p i. (DisplayStyle H \u003d log (přeloženo (n)) \u003d - sum _ (i \u003d 1) ^ (n) p_ (i) log p_ (i).)Takový výklad je také platný pro entropii RENI, což je jedním z zobecnění konceptu informační entropie, ale v tomto případě je určen efektivní počet systémových stavů (lze ukázat, že entropie RENI odpovídá k účinnému počtu států stanovených jako průměrný výkon vážený s parametrem Q ≤ 1 (DisplayStyle Q Leq 1) z velikosti 1 / P I (DisplayStyle 1 / p_ (i))) .

Je třeba poznamenat, že interpretace Sannonova vzorce založeného na váženém průměru není důvodem. Přísný výstup tohoto vzorce lze získat z kombinatorických úvah pomocí vzorce asymptotické stylingu a je to, že rozložení kombinatoriciality (tj. Počet způsobů, které mohou být implementovány) po užívání logaritmus a normalizace v limitu se shoduje s výrazem pro entropie ve formě, navržené shannon.

V širším smyslu, ve kterém je slovo často používáno v každodenním životě, entropie znamená měřítko poruchy nebo chaotického systému: Čím menší je prvky systému podléhají jakékoli pořadí, tím vyšší je entropie.

1 . Nechte nějaký systém zůstat v každém z N (DisplayStyle n) Dostupné podmínky s pravděpodobností P I (DisplayStyle p_ (i))kde i \u003d 1 ,. . . , N (\\ DisplayStyle I \u003d 1, ..., n). Entropie H (DisplayStyle H) je funkce pouze pravděpodobností P \u003d (p 1, .., p n) (displayStyle p \u003d (p_ (1), ..., p_ (n))): H \u003d H (P) (DisplayStyle H \u003d H (P)). 2 . Pro jakýkoli systém P (DisplayStyle P) Veletrh H (p) ≤ h (p u n i f) (displayStyle h (p) leq h (p_ (UNIF)))kde P u n i f (displayStyle p_ (UNIF)) - Systém s jednotným rozdělením pravděpodobnosti: P 1 \u003d p 2 \u003d. . . \u003d p n \u003d 1 / n (DisplayStyle p_ (1) \u003d p_ (2) \u003d ... \u003d p_ (n) \u003d 1 / n). 3 . Přidat do stavu systému p n + 1 \u003d 0 (DisplayStyle p_ (n + 1) \u003d 0)Systém entropie se nezmění. 4 . Entropie kombinace dvou systémů P (DisplayStyle P) a Q (\\ DisplayStyle Q) Má vzhled H (p q) \u003d h (p) + h (q / p) (displayStyle h (pq) \u003d h (p) + h (q / p))kde H (Q / P) (DisplayStyle H (Q / P)) - Průměr podle souboru P (DisplayStyle P) Podmíněný entropie Q (\\ DisplayStyle Q).Zadaný soubor Axiom jednoznačně vede ke vzorci pro entropii Shannon.

Různé disciplíny

- Termodynamická entropie je termodynamická funkce, která charakterizuje měřítko nevratné odvod energie v něm.

- Ve statistické fyzice charakterizuje pravděpodobnost určitého makroskopického stavu systému.

- V matematické statistice - měření nejistoty distribuce pravděpodobnosti.

- Informační entropie - v teorii informací o míře nejistoty zdroje zpráv, určené pravděpodobností vzhledu určitých znaků, pokud jsou přenášeny.

- Entropie dynamického systému - v teorii dynamických systémů měřítka chaotie v chování trajektorií systému.

- Diferenciální entropie je formální zobecnění konceptu entropie pro kontinuální distribuce.

- Odrazová entropie je součástí diskrétních informací o systému, které nejsou reprodukovány, když se systém odráží přes celou součtu jeho částí.

- Entropie v teorii kontroly je měřítkem nejistoty státu nebo chování systému v těchto podmínkách.

V termodynamice

Koncept entropie byl poprvé zaveden Clausiusem v termodynamice v roce 1865, aby určila měřítko nevratné rozptyl energie, opatření odmítnutí reálného procesu z ideálu. Definováno jako součet výsledného tepla, je to funkce stavu a zůstává konstantní s uzavřenými reverzibilními procesy, zatímco v nevratné - jeho změna je vždy pozitivní.

Matematicky entropie je definována jako funkce stavu systému definovanou s přesností libovolné konstanty. Rozdíl entropie ve dvou rovnovážných stavech 1 a 2, podle definice, se rovná sníženému množství tepla ( Δ q / t (DisplayStyle Delta Q / T)), který musí být hlášen systému, aby jej přeložil ze stavu 1 do státu 2 pro jakoukoliv kvázistickou cestu:

Δ s 1 → 2 \u003d s 2 - s 1 \u003d ∫ 1 → 2 δ qt (DisplayStyle Delta s_ (1 na 2) \u003d s_ (2) -s_ (1) \u003d \\ t 2) (Frac (Delta Q) (t))). (1) Vzhledem k tomu, že entropie je definována do libovolné konstanty, pak je možné podmíněnit podmínky 1 pro počáteční a dát S 1 \u003d 0 (DisplayStyle S_ (1) \u003d 0). Pak

S \u003d ∫ Δ q t (DisplayStyle s \u003d inst (FRAC (Delta Q) (t)))), (2.) Zde je integrál pořízen pro libovolný kvázistatický proces. Diferenciální funkce S (DisplayStyle S) Má vzhled

D s \u003d Δ q t (displayStyle ds \u003d (frac (Delta q) (t))). (3) Entropie vytváří vazbu mezi makro a micro stavy. Funkce této vlastnosti je, že se jedná o jedinou funkci ve fyzice, která ukazuje směr procesů. Vzhledem k tomu, že entropie je funkce funkce, nezávisí na tom, jak se provádí přechod z jednoho stavu systému do druhého, ale je určen pouze počátečními a koncovými stavy systému.

Entropie

Entropie

(od řečtiny. entropia - otočit)

Část vnitřní energie uzavřeného systému nebo energetické sady vesmíru, která nemůže být použita zejména, nemůže jít nebo být transformována na mechanickou práci. Přesná entropie se provádí pomocí matematických výpočtů. Nejvýraznější účinek entropie je viditelný na příkladu termodynamických procesů. Takže nikdy neexistuje zcela do mechanické práce, přemění do jiných typů energie. Je pozoruhodné, že v reverzibilních procesech zůstává hodnota entropie nezměněna, s nevratnou, naopak se neustále zvyšuje a tento nárůst nastane v důsledku poklesu mechanické energie. V důsledku toho jsou všechny nevratné procesy, které se vyskytují v přírodě doprovází poklesem mechanické energie, což by v konečném důsledku mělo vést k univerzální paralýzou, nebo, kdy jinak, "tepelné smrti". Ale takové jsou kompetentní pouze v případě postulování totalitářství vesmíru jako uzavřených empirických údajů. Kristus. Teologie založené na entropii, hovořili o končetině světa, používat ji jako existenci Boha.

Filozofický encyklopedický slovník.. 2010 .

Entropie

(Řecká ἐντροπία - tah, transformace) - stav termodynamic. Systémy charakterizující směr proudění spontánních procesů v tomto systému a je měřítkem jejich nevratnosti. Koncepce E. byl zaveden v roce 1865 R. Clausius charakterizovat procesy konverze energie; V roce 1877 mu L. Bolzman dal statistiku. výklad. S pomocí konceptu E. Druhý začátek termodynamiky je formulován: E. Tepelně izolovaný systém je vždy jen zvyšuje, tj. Takové, udělené samo o sobě, usiluje o termální rovnováhu, s KR. E. Maximum. Ve statistickém. Fyzika E. Vyjadřuje nejistotu mikroskopického. Stav systému: čím více mikroskopicky. Stav států odpovídají tomuto makroskopickému. Stát je vyšší termodynamický. A E. Poslední. Systém s nepravděpodobnou strukturou poskytovanou sám se vyvíjí směrem k nejpravděpodobnější struktuře, tj. Ve směru E. To však platí pouze pro uzavřené systémy, takže E. nelze použít k podkladu tepelné smrti vesmíru. V teorii a n f o R a C a E. je považován za nedostatek informací v systému. V Cybernetics, s pomocí pojmů E. a Negentropy (popírání. Entropie) vyjadřují míru organizace systému. Být spravedlivý ve vztahu k systémům, které poslouchají statistické. Zákony, toto opatření však vyžaduje velkou opatrnost při přenosu na biologické, jazykové a sociální systémy.

Svítí: Shambadal P., vývoj a aplikace konceptu E., [za rok. str.], M., 1967; Pier J., symboly, signály, hluk, [per. Z angličtiny], M., 1967.

L. Fetkin. Moskva.

Filozofická encyklopedie. V 5 tunách - M.: Sovětská encyklopedie. Upravil F. V. Konstantinová. 1960-1970 .

Synonyma:Sledujte, co je "entropie" v jiných slovnících:

- (od řečtiny. entropia otočení, transformace), koncept poprvé vstoupil do termodynamiky k určení měřítka nevratného rozptylu energie. E. Široce aplikovaný v jiných oblastech vědy: ve statistické fyzice jako míra pravděpodobnosti realizace. ... ... Fyzická encyklopedie

Entropie, indikátor náhody nebo poruchy struktury fyzického systému. V termodynamice, entropie vyjadřuje množství tepelné energie vhodné pro výkonnost práce: energie je menší, čím vyšší je entropie. V měřítku vesmíru ... ... ... Vědecký a technický encyklopedický slovník

Měření vnitřní poruchy informačního systému. Entropie se zvyšuje s chaotickou distribucí informačních zdrojů a snižuje s jejich objednávkou. V angličtině: entropie viz také: Informace Finanční slovník Finam ... Finanční slovní zásoba

- [Angličtina. Entropie ruské jazykové cizí slova

Entropie - entropie ♦ entropie vlastnost izolovaného (nebo adoptovaného) fyzického systému charakterizovaného množstvím spontánní změny, na které je schopen. Systém entropie dosáhne maxima, když je zcela ... Filozofický slovník sponville.

- (z řečtiny. entropia otočení) (obvykle označuje), funkce stavu termodynamického systému, změna, z nichž DS v rovnovážném způsobu se rovná poměru množství tepla DQ, hlášené systémem nebo od něj přidělen, ... ... Velký encyklopedický slovník.

Porucha, porucha slovníku ruských synonym. Entropie Sut., Počet synonym: 2 porucha (127) ... Synonym Slovník. Slovník

Entropie - (z řečtiny. en In, uvnitř a tahu, transformace), hodnota charakterizující míru související energie (D S), která v izotermním procesu nelze zapnout do provozu. Je určen logaritmem termodynamické pravděpodobnosti a ... ... ... ... Ekologický slovník.

entropie - a g. Entropie f., To. Entropie c. En, uvnitř + tah, transformace. 1. Fyzikální množství charakterizující tepelný stav těla nebo systému těl a možných změn v těchto státech. Výpočet entropie. Bass 1. || ... ... ... ... Historický slovník galicalismu ruský jazyk

Entropie - entropie, koncept podávaný v termodynamice, jako by měřítko nevratnosti procesu, míra přechodu energie v takové formě, ze které nemůže spontánně jít do jiných forem. Všechny představitelné procesy vyskytující se v jakémkoli systému ... ... ... Velká lékařská encyklopedie

Knihy

- Statistická mechanika. Entropie, parametry objednávky, teorie složitosti, James P. Seat. Výuka "Statistická mechanika: entropie, parametry řádu a složitosti", napsaný profesorem Cornell University (USA) James One a byl publikován poprvé v angličtině v roce 2006 ...

Entropie je hodnota, která charakterizuje stupeň disordexu, stejně jako tepelný stav vesmíru. Řekové určili tento koncept jako transformaci nebo převrat. Ale v astronomii a fyzice je jeho význam poněkud vynikající. V jednoduchém jazyce je entropie měřítkem chaosu.

Výhled

Ve vědě, tento koncept vstoupil v XIX století. Zpočátku byl aplikován na teorii tepelných strojů, ale docela rychle se objevil ve zbytku fyzikálních oblastí, zejména v teorii záření. Velmi brzy začala entropie používat v kosmologii, biologii, v teorii informací. Různé oblasti znalostí přidělují různé typy opatření chaosu:

- informace

- termodynamic.

- rozdíl

- kulturní

Například pro molekulární systémy existuje boltzmann entropie, která určuje měřítko jejich chaotie a homogenity. Bolzman se podařilo navázat vztah mezi opatřením chaosu a pravděpodobností státu. Pro termodynamiku je tento koncept považován za míru nevratné energetické rozptylu. To je funkce stavu termodynamického systému.

V samostatném systému roste entropie na maximální hodnoty a nakonec se stávají rovnovážným stavem.

Informace o entropii předpokládá určité míře nejistoty nebo nepředvídatelnosti.

Entropie vesmíru

Pro vesmír nelze aplikovat klasické provedení entropie, protože je v něm aktivní, gravitační síly jsou aktivní a samotná látka nemůže tvořit uzavřený systém. Ve skutečnosti, pro vesmír je to míra chaosu. Nákupy přesně vypočítat hodnotu chaosu. Všechny odhady entropie vesmíru však mají významnou změnu hodnot získaných - od jedné do tří objednávek. To je vysvětleno nejen nedostatkem znalostí. Neexistuje žádná nedostatečnost informací o účincích na výpočty nejen ze všech známých nebeských objektů, ale i temné energie. Studium jeho vlastností a vlastností je stále v následujícím a účinek může být rozhodující. Mera Chaos vesmír se mění po celou dobu.

Tepelná smrt vesmíru

Každý uzavřený termodynamický systém má konečný stav.Vesmír není také výjimkou. Když se směrová výměna všech typů energií zastaví, jsou zamítnuty do tepelné energie. Systém přepne do stavu tepelné smrti, pokud termodynamická entropie obdrží nejvyšší hodnotu. Závěr o takovém pozdním světě byl formulován R. Clausiusem v roce 1865. Jako základ vzal druhý zákon termodynamiky. Podle tohoto zákona bude systém, který není vyměněn s energiemi s jinými systémy, bude hledat rovnovážný stav. A může mít parametry charakteristické pro tepelnou smrtí vesmíru. Ale Clausius nebral v úvahu vliv gravitace. To znamená, že pro vesmír na rozdíl od systému dokonalého plynu, kde jsou částice rovnoměrně rozloženy v určitém objemu, homogenita částic nemůže odpovídat největší hodnotě entropie. Nicméně, to není jasné, entropie je přípustným měřítkem chaosu nebo smrti vesmíru?

V našem životě

V vrcholu druhého začátku termodynamiky, podle ustanovení, jejichž by se vše mělo vyvíjet od obtížných jednoduchých, vývoj Evoluce Země se pohybuje v opačném směru. Tato nesrovnalost je způsobena termodynamikou procesů, které jsou nevratné. Spotřeba živého organismu, pokud je to představit jako otevřený termodynamický systém, se vyskytuje v menších svazcích, spíše než vyřazen z něj.

Potraviny mají méně entropie než produkty vyrobené z nich.

To znamená, že tělo je naživu, protože to může odhodit toto opatření chaosu, který je vyroben v něm v důsledku toku nevratných procesů. Například odpařením z těla je odvozeno asi 170 g vody, tj. Lidské tělo kompenzuje snížení entropie s některými chemickými a fyzikálními procesy.

Entropie je určitým měřítkem volného stavu systému. Je to nejpletnější než menší omezení Tento systém má, ale za předpokladu, že existuje mnoho stupňů svobody. Ukazuje se, že nulová hodnota opatření Chaosu je úplná informace a maximum je absolutní nevědomost.

Náš celý život je tuhý entropie, protože opatření chaos někdy překračuje měřítko zdravého rozumu. Možná nejde tak daleko, když přijdeme na druhý začátek termodynamiky, protože někdy se zdá, že vývoj některých lidí a celých států, již se zvrátil, to znamená od složitého k primitivu.